竹内 健 教授

本郷キャンパス

大学院工学系研究科・電気系工学専攻

学科電子情報工学科

半導体システム分野

高性能計算

知覚情報処理

電子デバイス・電子機器

人工知能

深層学習・生成AI

量子コンピューティング

半導体

自動運転・自律ロボット

データセントリックコンピューティング(AI・Computation in Memory・量子コンピュータ)

脳のようにデータの処理と記憶が融合したデータ中心のコンピューティング、CiM (Computation in Memory)を研究しています。AI時代に向けて、LSIのハード・制御ソフト・機械学習から応用・社会実装まで、分野を越境し異分野をCo-designする人材を育成します。

研究分野1

Computation of event sensing data

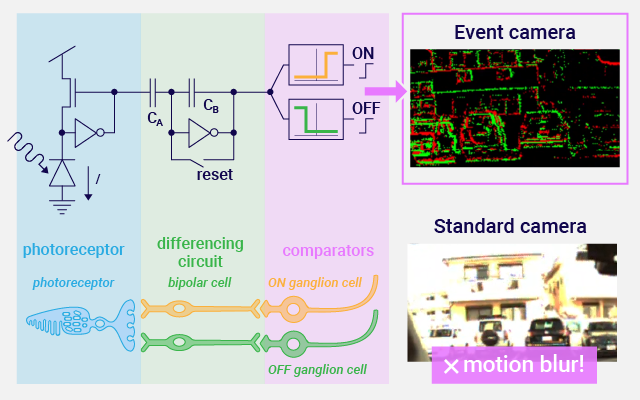

イベントカメラは人間の網膜のように、受光した光の対数強度に変化があったときに非同期でイベント信号を出力します。イベントカメラの画素は、光の対数強度に応答する受光回路、差分回路、コンパレータから構成され、高いダイナミックレンジを持ちます。イベントが発生した時だけデータを処理することで、冗長なデータ処理を削減し高速低電力にデータを処理できる、ニューロモルフィック回路システムの研究を行っています。従来のフレームベースのカメラでは、フレーム間に移動した点はぶれた画像となります(motion blur)。一方、本研究ではイベントデータを迅速に処理することでmotion blurを無くし、自動運転車、ドローンなどの移動体が正確に周囲の環境や物体を認識し、高速かつ安全・安心に動作することを目指しています。

研究分野2

Computation in memory

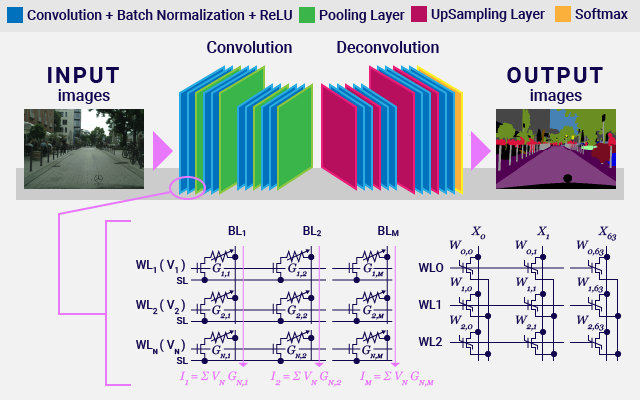

自動運転の応用では、画像認識や物体認識を深層学習で行う際に、膨大な数の積和演算(MAC:Multiply Accumulation)を行います。竹内研究室では深層学習に適したComputation in memory(CiM)の研究を行っています。ReRAM(抵抗変化型メモリ)、FeFET(強誘電体FET)といった不揮発性メモリにニューラルネットワークの重みを記憶し、不揮発性メモリセルアレイを同時に超並列で駆動することで、深層学習の推論を高速・低電力に行います。

研究分野3

AI chip

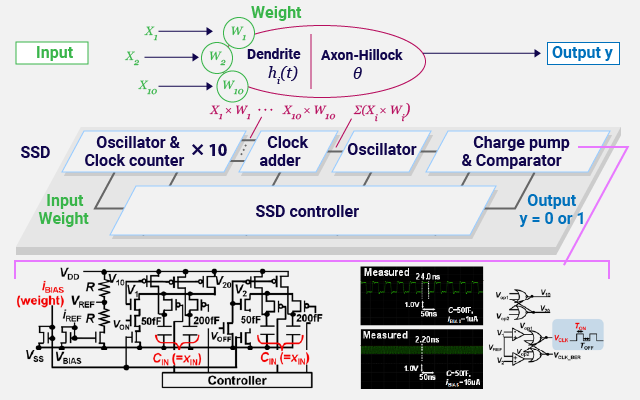

竹内研究室では機械学習を高速・低電力に実行するプロセッサ(AIチップ)の研究を行っています。一例として、アナログ回路を使って人間のニューロンを模倣するニューロモルフィックコンピューティングがあります。これまでに、発振回路のオン時間・オフ時間をニューラルネットワークへの入力や重みに応じて柔軟に制御することで、時間軸上でMAC演算を実現しました。その結果、電力効率を約10倍高めることに成功しました。

研究分野4

Approximate computing

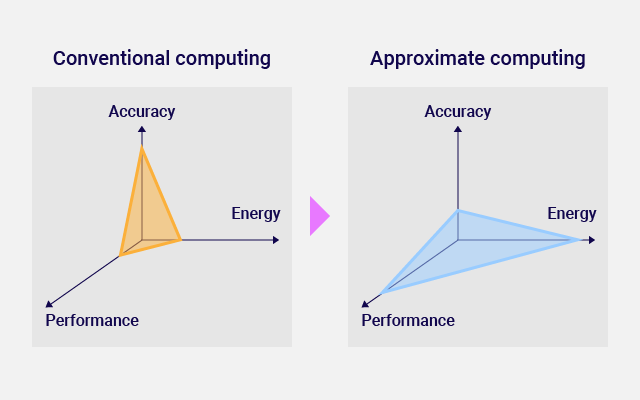

コンピュータを構成するプロセッサやメモリには性能・電力・コスト(価格)・信頼性の間にトレードオフがあり、これら全てを解決することは難しいです。従来のコンピューティングではプログラムを順次実行する逐次処理を行うため、エラーを許容できませんでした。一方、機械学習を用いた画像認識や音声認識では、ある程度のエラー・不正確さが許容されます。そもそも人間の認識も完璧ではありません。竹内研究室が取り組む機械学習向けのApproximate computingでは、プロセッサやメモリといったLSIのレベルではエラー・不正確さを許容します。それにより、性能や電力の向上を図ります。一方、アプリケーションレベルにおける機械学習の認識では、従来のコンピューティングと同様に正確な認識を行います。このように今後のAI応用を狙い、各応用に最適化したDomain-specific computingの研究を行っています。

研究分野5

Brain-inspired memory

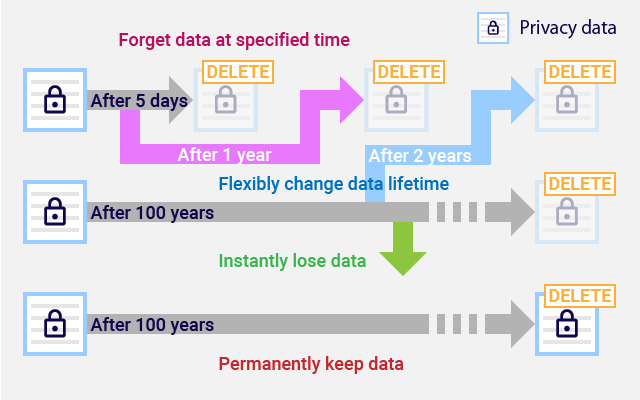

大事なデータは永久に記憶し、秘匿が必要なプライバシーデータは適切な時に忘却します。データの寿命を記憶時に自由に指定できるだけでなく、データを保存している途中でデータの寿命を長くしたり短くしたりする変更が可能です。忘れられる権利のためのプライバシーを意識し、機微なデータは復元不能に(完全に)消去することもできます。ソフトウエア技術だけでは解決できないプライバシーデータの保護を、ハードウエア技術で実現します。